Guide comparatif des robots d'exploration web : Outils SEO techniques qui fonctionnent pour WordPress en 2026

John Turner

John Turner

John Turner

John Turner

Vous regardez un site WordPress de plus de 500 pages, et votre client souhaite un audit complet des liens brisés.

Vous pourriez parcourir chaque page manuellement, ou laisser un robot d'exploration web faire le gros du travail en environ 20 minutes.

Les robots d'exploration web sont des bots automatisés qui parcourent systématiquement les sites web, suivent tous les liens qu'ils trouvent et cataloguent ce qu'ils découvrent.

Que vous auditiez votre site pour des problèmes techniques, que vous vous prépariez à une migration ou que vous validiez qu'un déménagement s'est déroulé sans accroc, un robot d'exploration web est l'un des outils les plus puissants de votre arsenal. Le problème est que les options se ressemblent en surface, jusqu'à ce que vous soyez au cœur d'un audit et que vous réalisiez que vous avez choisi la mauvaise.

Nous utilisons régulièrement des robots d'exploration dans le cadre de notre flux de travail de migration et de sauvegarde WordPress, ce qui nous donne une perspective spécifique : quels outils vous aident réellement à déplacer et à protéger les sites WordPress, et pas seulement à générer des rapports.

Voici les points clés à retenir :

- Screaming Frog est l'auditeur technique le plus puissant. Il est basé sur un ordinateur de bureau, hautement configurable, gratuit jusqu'à 500 URL et 279 $/an pour un nombre illimité.

- Ahrefs Site Audit a le meilleur niveau gratuit : 5 000 pages/mois via Ahrefs Webmaster Tools, sans frais.

- Semrush et Ahrefs Site Audit ne valent la peine que si vous êtes déjà sur ces plateformes. À 117-129 $/mois, le coût est difficile à justifier pour le seul crawl.

- Webscraper.io est un outil d'extraction de données, pas un auditeur SEO - un cas d'utilisation complètement différent, mais le meilleur outil pour ce travail.

- Pour les migrations WordPress, exécutez toujours un crawl avant et après la migration. C'est le seul moyen fiable de détecter les pages perdues, les redirections brisées ou les métadonnées modifiées.

Table des matières

- Robots d'exploration web en un coup d'œil

- Qu'est-ce qu'un robot d'exploration web ?

- Pourquoi utiliser un robot d'exploration web ?

- Comment nous avons évalué les robots d'exploration web pour WordPress

- Nos recommandations de robots d'exploration Web pour WordPress

- Comment utiliser un explorateur web pour une migration WordPress

- Questions fréquemment posées (FAQ)

Robots d'exploration web en un coup d'œil

| Robot d'exploration web | Idéal pour | Niveau gratuit | Tarifs payants | Méthode de crawl |

| Screaming Frog | Audits techniques approfondis | 500 URL | 279 $/an | Application de bureau |

| Webscraper.io | Extraction rapide de données | Extension de navigateur | 100 $/mois (cloud) | Navigateur / Cloud |

| Audit de site Semrush | Utilisateurs de la plateforme SEO tout-en-un | Limité (Semrush gratuit) | 117 $/mois (Semrush) | Nuage |

| Audit de site Ahrefs | Combo backlinks + technique | 5 000 pages/mois | 129 $/mois (Ahrefs) | Nuage |

Qu'est-ce qu'un robot d'exploration web ?

Un web crawler (également appelé spider ou bot) est un robot Internet qui parcourt systématiquement le Web pour indexer et cataloguer des pages.

L'exemple le plus célèbre ? Googlebot.

Googlebot commence avec une liste d'URL connues provenant de crawls précédents et de sitemaps. Il visite chaque page, lit le contenu et suit tous les liens qu'il trouve. Ces nouveaux liens sont ajoutés à sa file d'attente pour de futures visites.

Ce processus se répète sans fin, construisant l'énorme index de pages Web de Google.

Vous pouvez exécuter une version à plus petite échelle sur votre propre site Web. Au lieu d'indexer Internet tout entier, votre crawler cartographie la structure et le contenu complets de votre site avec une précision au niveau de la machine.

Lorsque vous exécutez un crawler sur votre propre site, vous obtenez la même visibilité au niveau de la machine que Google. Il vous donnera une carte complète de chaque URL, code d'état, balise de titre et structure de liens internes sur votre domaine.

Pourquoi utiliser un robot d'exploration web ?

Pour les utilisateurs de WordPress, les web crawlers sont utiles de trois manières spécifiques :

- Audits SEO techniques : trouvez les liens brisés, les chaînes de redirection, les titres dupliqués, les méta-descriptions manquantes et le contenu mince avant qu'ils ne nuisent à votre classement

- Audits de contenu : mettez en évidence les pages oubliées : anciennes pages de destination, archives de balises générées automatiquement ou contenu dupliqué qui s'accumule avec le temps

- Migrations de site : vérifiez que chaque page a été transférée correctement lors du passage à un nouvel hébergeur, domaine ou serveur

La raison principale d'utiliser un web crawler est pour les audits SEO techniques.

Les crawlers excellent à identifier les liens brisés, les redirections défectueuses qui envoient les utilisateurs en cercle, les titres de page manquants ou dupliqués, les méta-descriptions vides et les pages de contenu mince qui pourraient nuire à votre classement.

L'audit de contenu est un autre cas d'utilisation majeur.

Les crawlers découvrent fréquemment des pages oubliées qui peuvent nuire à votre SEO, comme les archives de balises générées automatiquement, les anciennes pages de destination ou le contenu dupliqué qui s'est accumulé au fil du temps. Ces pages passent souvent inaperçues lors des audits manuels mais apparaissent immédiatement dans un crawl complet.

Mais voici où les crawlers deviennent absolument essentiels : les migrations de site Web.

Lorsque vous déplacez un site WordPress vers un nouveau domaine ou serveur, un crawler crée une carte complète de votre ancien site. Vous pouvez ensuite la comparer à votre nouveau site pour vérifier que chaque page, chaque redirection et chaque fichier important a bien été transféré.

Sans cette étape de vérification, vous croisez essentiellement les doigts et espérez que rien n'a été perdu dans la traduction.

Comment nous avons évalué les robots d'exploration web pour WordPress

Nous avons évalué chaque crawler selon cinq critères importants pour les flux de travail WordPress :

| Critères | Ce que nous avons recherché |

| Facilité d'installation | En combien de temps un non-développeur peut-il lancer un crawl ? |

| Profondeur du crawl | Gère-t-il le rendu JavaScript, la pagination et les grands sites ? |

| Qualité des rapports | Les erreurs sont-elles priorisées par gravité ? Pouvez-vous filtrer et exporter ? |

| Adaptation à WordPress | Y a-t-il un intérêt spécifique pour les propriétaires de sites WP et les agences ? |

| Rapport qualité-prix | Quel est le coût réel pour le cas d'utilisation pour lequel il est le mieux adapté ? |

Nous avons testé chaque outil sur des sites WordPress allant de petits blogs à de grands réseaux multisites. Les prix sont vérifiés en avril 2026.

Nos recommandations de robots d'exploration Web pour WordPress

Le bon robot d'exploration dépend de votre niveau de confort technique et de ce que vous essayez d'accomplir.

Certains sont conçus pour les professionnels du SEO. D'autres s'adressent aux propriétaires d'entreprise qui veulent simplement pointer, cliquer et obtenir des résultats.

Voici ma répartition des meilleures options :

- Screaming Frog SEO Spider : Application de bureau qui est la référence pour les professionnels du SEO technique, gratuite jusqu'à 500 URL

- Webscraper.io : Extension Chrome pour des tâches rapides d'extraction de données sans installation de logiciel

- Semrush Site Audit : Robot d'exploration complet au sein de la plateforme SEO complète Semrush

- Ahrefs Site Audit : Robot d'exploration rapide avec une excellente visualisation, gratuit jusqu'à 5 000 pages par mois

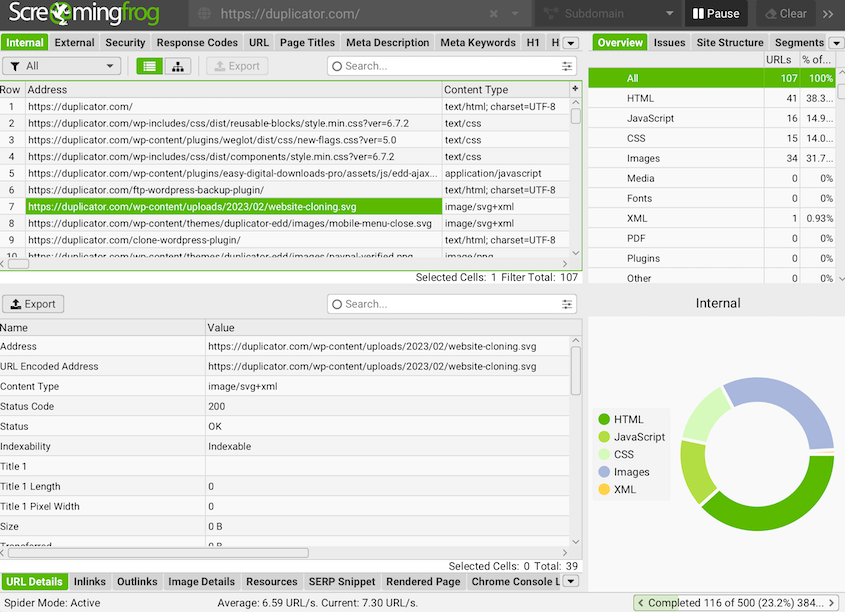

Screaming Frog SEO Spider

Screaming Frog explore votre site pour trouver les liens brisés, auditer les redirections, analyser les titres de page et les méta-descriptions, et extraire des données spécifiques à l'aide de sélecteurs CSS Path ou XPath. Il peut gérer le rendu JavaScript, suivre les liens externes et exporter le tout en CSV pour une analyse plus approfondie.

Cette application de bureau (disponible pour Windows, macOS et Ubuntu) est la référence pour les professionnels du SEO technique depuis des années.

La version gratuite explore jusqu'à 500 URL, ce qui couvre la plupart des sites WordPress de petite à moyenne taille. Pour les sites plus grands, la licence payante supprime cette limite et ajoute des fonctionnalités telles que l'extraction personnalisée, l'intégration Google Analytics et les crawls planifiés.

L'interface peut sembler intimidante au début. Cependant, je trouve que la profondeur des données qu'elle fournit est inégalée.

Webscraper.io

Webscraper.io est une extension Chrome qui se concentre sur les tâches rapides d'extraction de données.

Le facteur de commodité est énorme ici - aucun logiciel à installer, aucune configuration complexe. Vous créez un « sitemap » (leur terme pour un plan de scraping) directement dans votre navigateur, en lui indiquant quels éléments cliquer et quelles données extraire.

Webscraper.io est parfait pour les petites tâches comme la récupération d'une liste de titres d'articles de blog d'un site concurrent ou la collecte d'informations sur les produits de quelques pages. Le sélecteur visuel permet de cibler facilement exactement ce dont vous avez besoin.

La version gratuite gère les tâches de scraping de base. Les plans payants ajoutent le crawling basé sur le cloud, les exécutions planifiées et l'accès API pour intégrer les données dans d'autres outils.

Audit de site Semrush

Semrush est l'une des plateformes d'audit SEO les plus populaires. Elle fournit des kits d'outils complets aux spécialistes du marketing et aux entreprises pour développer leur SEO.

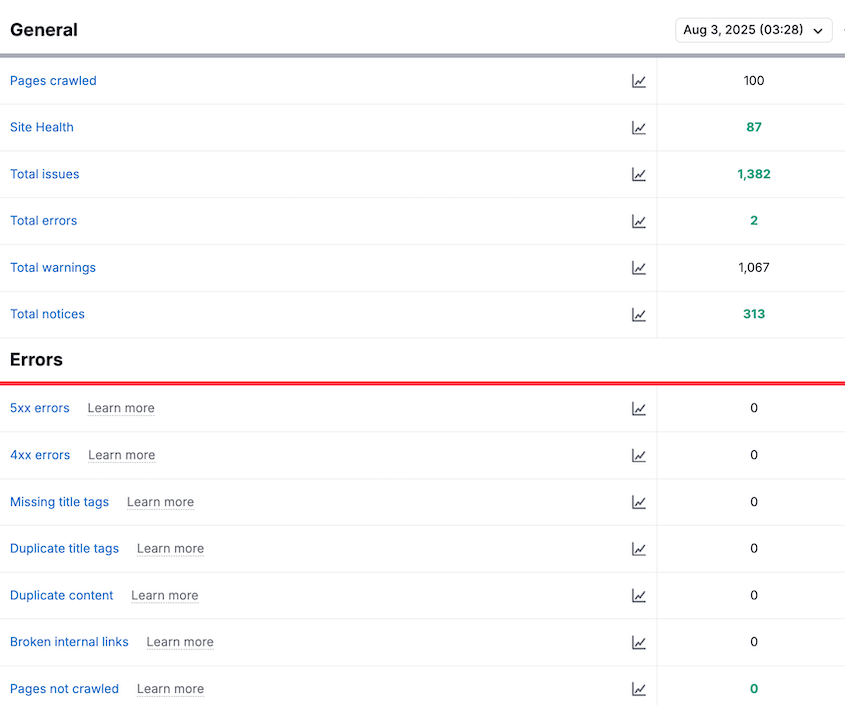

Pour le SEO on-page et technique, Semrush fournit un outil d'audit de site. Celui-ci est alimenté par une technologie de crawling.

Semrush va explorer votre site web à la recherche de problèmes de santé tels que le contenu dupliqué, les balises de titre manquantes, les images brisées et d'autres erreurs. Une fois que vous connaissez ces problèmes, vous pouvez les résoudre.

Si vous payez déjà pour Semrush, l'explorateur d'audit de site est inclus. Cependant, les forfaits Semrush commencent à 117 $/mois, il n'est donc probablement pas utile de s'abonner uniquement pour l'explorateur, à moins que vous n'ayez l'intention d'utiliser les autres outils SEO également.

Audit de site Ahrefs

Comme Semrush, Ahrefs effectue un audit de site complet dans sa boîte à outils SEO.

L'explorateur est rapide et l'interface fait un excellent travail de visualisation des erreurs techniques. Il vous donne un score SEO global et une liste de problèmes potentiels.

De plus, il s'intègre à d'autres outils Ahrefs comme le Rank Tracker et le Site Explorer. Vous pouvez voir comment les problèmes techniques sont corrélés avec les performances de classement et les profils de backlinks.

Vous pouvez utiliser l'audit de site d'Ahrefs gratuitement jusqu'à 5 000 pages explorées par mois.

Les utilisateurs de Semrush Enterprise peuvent également utiliser la fonctionnalité Crawler Profiles de Semrush (lancée en 2026) pour simuler exactement comment des agents IA spécifiques voient et interprètent vos pages.

Comment utiliser un explorateur web pour une migration WordPress

C'est là que les explorateurs prouvent leur valeur. Une migration appropriée implique deux explorations : une avant de déplacer le site et une après.

Étape 1 : Le crawl de référence avant migration

Dans un premier temps, avant de migrer votre site web, créez un inventaire complet de votre site actuel en l'explorant.

Lancez votre explorateur choisi et exécutez-le sur votre site source. Configurez-le pour capturer l'URL, le code d'état HTTP, le titre de la page, la méta-description, les balises H1 et le nombre de mots pour chaque page qu'il trouve.

Exportez toutes ces données dans une feuille de calcul. Cela devient votre enregistrement définitif de l'apparence de votre site avant la migration.

Étape 2 : Exécutez votre migration

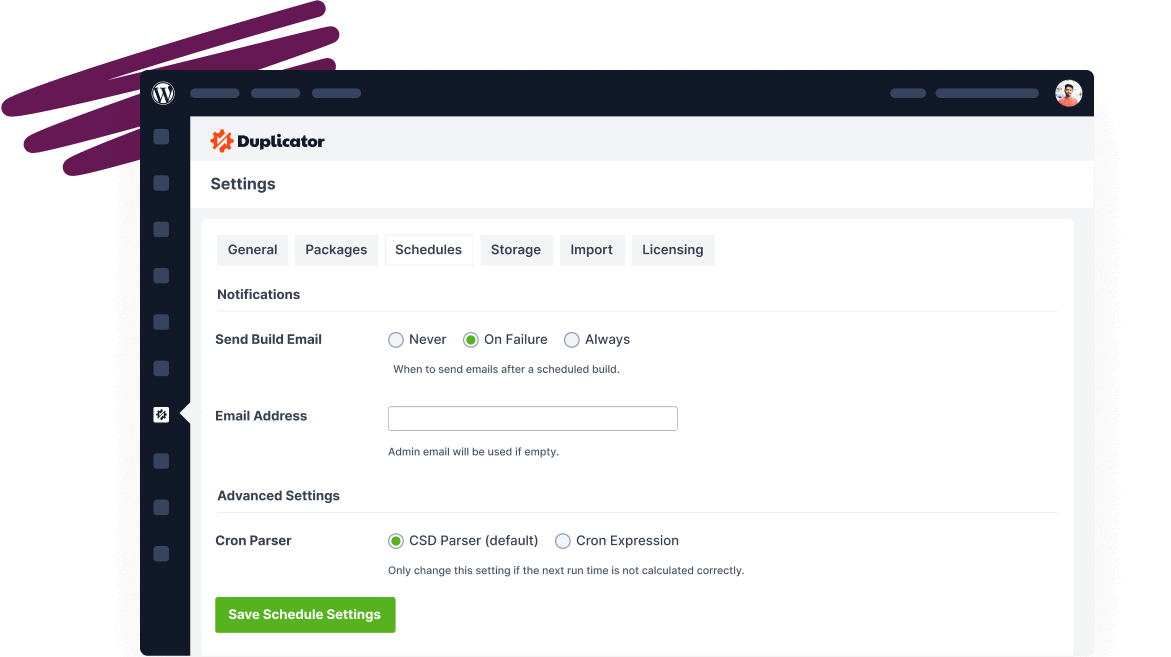

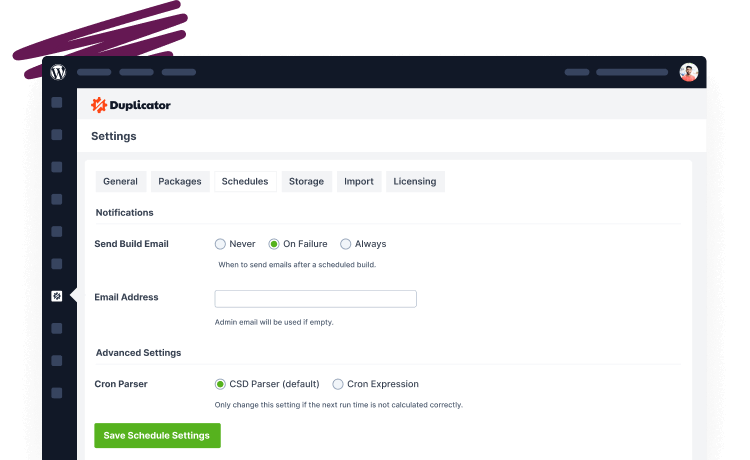

C'est là que Duplicator intervient. Pendant que votre explorateur documente l'état avant, Duplicator gère le déplacement réel.

Duplicator empaquetera l'intégralité de votre site WordPress dans un seul fichier de sauvegarde, le déplacera vers le nouvel hôte ou domaine, et gérera automatiquement la recherche et le remplacement dans la base de données.

Vous pouvez également créer une capture d'instantané de sauvegarde complète ici afin d'avoir un point de restauration si la validation révèle des problèmes.

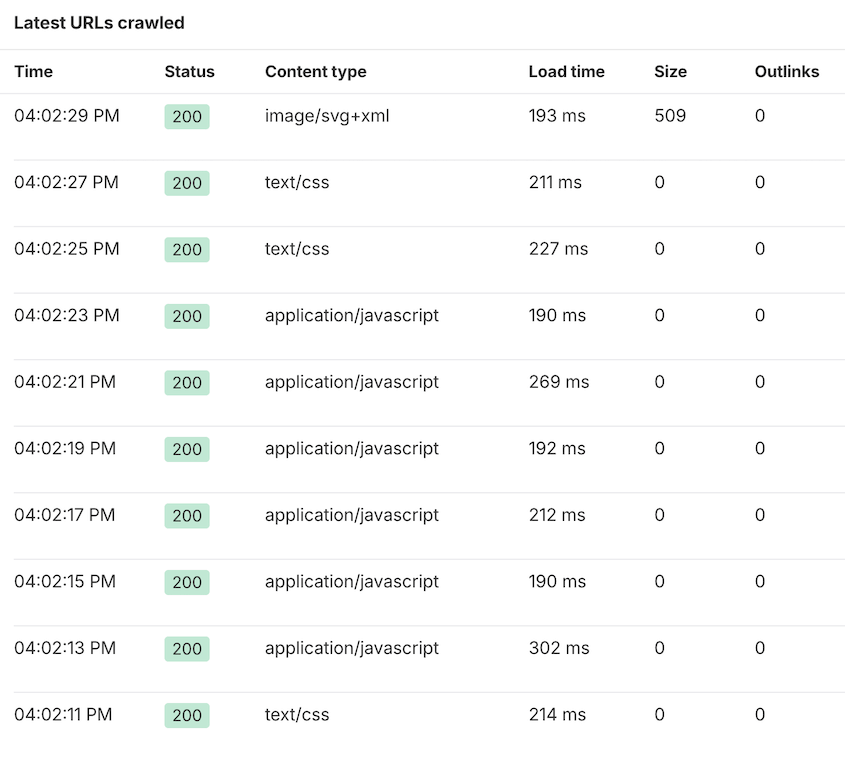

Étape 3 : Le crawl de validation après migration

Après avoir déplacé votre site vers son nouvel emplacement, exécutez la même configuration d'exploration sur votre site de destination.

Place au travail de détective : comparez les deux feuilles de calcul. Utilisez la fonction RECHERCHEV d'Excel (ou des outils similaires dans Google Sheets) pour rapprocher les données.

Recherchez les pages qui ont renvoyé des codes d'état 200 sur l'ancien site mais qui renvoient des 404 sur le nouveau. Vérifiez que vos redirections fonctionnent correctement : une redirection 301 sur l'ancien site doit toujours être une redirection 301 sur le nouveau site. Vérifiez que les titres de page et les méta-descriptions ont été transférés intacts.

Ce processus de comparaison permet de détecter les problèmes de migration qui pourraient autrement passer inaperçus pendant des mois.

Questions fréquemment posées (FAQ)

L'exploration web est-elle légale ?

Généralement, oui : l'exploration de pages web accessibles publiquement est légale si vous respectez robots.txt et que vous explorez à un rythme raisonnable. Cependant, certains sites interdisent l'exploration dans leurs conditions d'utilisation. En cas de doute, explorez vos propres sites ou obtenez une autorisation explicite.

Quelle est la différence entre un web crawler, un scraper et un spider ?

Un crawler (ou spider) découvre et visite des pages web en suivant des liens, tandis qu'un scraper extrait des données spécifiques de ces pages. La plupart des outils modernes effectuent les deux fonctions. Comprendre la distinction aide à évaluer différents outils pour des tâches spécifiques.

Quels sont les types de web crawlers ?

Les web crawlers se répartissent en quatre catégories principales : les crawlers SEO techniques (comme Screaming Frog), les outils d'extraction de données (comme Octoparse), les crawlers de suites intégrées (intégrés aux plateformes SEO) et les frameworks de développement (comme Scrapy). Chacun répond à des besoins et des niveaux de compétence différents.

Quel est le meilleur web crawler gratuit ?

Pour le travail de SEO technique, le niveau gratuit de Screaming Frog gère jusqu'à 500 URL. Pour une extraction de données rapide, l'extension de navigateur Webscraper.io fonctionne bien sans installation de logiciel.

Un crawler va-t-il ralentir ou nuire à mon site web ?

Un crawler agressif peut ralentir votre site comme un pic de trafic, surtout sur un hébergement mutualisé. Les bons outils de crawling vous permettent de contrôler la vitesse de crawl avec des délais entre les requêtes et des limites de connexion. Utilisez toujours ces paramètres sur les sites de production.

Comment contrôler quels web crawlers peuvent accéder à mon site ?

Le fichier robots.txt indique aux crawlers quelles parties de votre site ils peuvent accéder. Placez-le à votresite.com/robots.txt pour bloquer des crawlers spécifiques ou restreindre l'accès aux répertoires. Gardez à l'esprit que les crawlers bien élevés le respectent, mais les bots malveillants peuvent l'ignorer.

AutoGPT peut-il faire du web scraping ?

AutoGPT peut écrire du code pour des scrapers web en utilisant des bibliothèques comme Scrapy, mais il n'effectue pas le crawling lui-même. Considérez-le comme un assistant de codage qui aide à construire des outils de scraping. Vous devez toujours exécuter le code généré pour réellement crawler les sites web.

Votre plan d'action : Choisir le bon web crawler

Voici comment choisir le bon crawler pour votre situation :

- Gratuit et rapide : Ahrefs Webmaster Tools (5 000 pages, sans frais)

- Audit technique approfondi : Screaming Frog (gratuit jusqu'à 500 URL, 279 $/an pour plus)

- Déjà sur Semrush ou Ahrefs : Utilisez Site Audit ; il est déjà inclus

- Besoin uniquement de scraper des données spécifiques : Extension Chrome Webscraper.io

Vous pouvez effectuer l'audit de crawler le plus approfondi au monde, mais si votre outil de migration perd des fichiers, corrompt des bases de données ou endommage la structure de votre site, toute cette préparation devient inutile.

C'est pourquoi je recommande d'associer votre crawler à Duplicator Pro. Pendant que votre crawler gère la vérification avant et après, Duplicator Pro s'occupe du travail de fond réel pour déplacer votre site WordPress.

Prêt à améliorer votre flux de migration ? Essayez Duplicator Pro dès aujourd'hui et découvrez pourquoi des milliers de professionnels WordPress lui font confiance pour leurs déplacements de site.

Pendant que vous êtes ici, je pense que vous aimerez ces ressources WordPress sélectionnées avec soin :