Web-Crawler-Vergleichsleitfaden: Technische SEO-Tools, die 2026 für WordPress funktionieren

John Turner

John Turner

John Turner

John Turner

Sie blicken auf eine WordPress-Website mit über 500 Seiten, und Ihr Kunde wünscht eine vollständige Überprüfung auf defekte Links.

Sie könnten jede einzelne Seite manuell durchgehen oder einen Webcrawler die Hauptarbeit in etwa 20 Minuten erledigen lassen.

Webcrawler sind automatisierte Bots, die systematisch Websites durchsuchen, jedem Link folgen, den sie finden, und das Entdeckte katalogisieren.

Ob Sie Ihre Website auf technische Probleme überprüfen, sich auf eine Migration vorbereiten oder validieren, dass ein Umzug reibungslos verlief – ein Webcrawler ist eines der leistungsstärksten Werkzeuge in Ihrem Arsenal. Das Problem ist, dass die Optionen oberflächlich ähnlich aussehen, bis Sie tief in einer Überprüfung stecken und feststellen, dass Sie die falsche gewählt haben.

Wir verwenden Crawler regelmäßig als Teil unseres WordPress-Migrations- und Backup-Workflows, was uns eine spezifische Perspektive gibt: Welche Tools helfen Ihnen tatsächlich, WordPress-Websites zu verschieben und zu schützen, und nicht nur Berichte zu erstellen.

Hier sind die wichtigsten Erkenntnisse:

- Screaming Frog ist der leistungsstärkste technische Auditor. Es ist Desktop-basiert, tief konfigurierbar, kostenlos bis zu 500 URLs und kostet 279 $/Jahr für unbegrenzte.

- Ahrefs Site Audit hat die beste kostenlose Stufe: 5.000 Seiten/Monat über Ahrefs Webmaster Tools, kostenlos

- Semrush und Ahrefs Site Audit lohnen sich nur, wenn Sie bereits auf diesen Plattformen sind. Mit 117–129 $/Monat sind die Kosten für reines Crawling schwer zu rechtfertigen.

- Webscraper.io ist ein Datenextraktionstool, kein SEO-Auditor – ein völlig anderer Anwendungsfall, aber das beste Werkzeug für diese Aufgabe.

- Führen Sie für WordPress-Migrationen immer einen Crawl vor und nach der Migration durch. Es ist der einzig zuverlässige Weg, um verlorene Seiten, defekte Weiterleitungen oder geänderte Metadaten zu erkennen.

Inhaltsverzeichnis

Webcrawler im Überblick

| Webcrawler | Am besten für | Kostenloser Tarif | Kostenpflichtige Preise | Crawl-Methode |

| Screaming Frog | Tiefgehende technische Audits | 500 URLs | 279 $/Jahr | Desktop-App |

| Webscraper.io | Schnelle Datenextraktion | Browser-Erweiterung | 100 $/Monat (Cloud) | Browser / Cloud |

| Semrush Website-Audit | Nutzer der All-in-One-SEO-Plattform | Begrenzt (Semrush Free) | 117 $/Monat (Semrush) | Cloud |

| Ahrefs Website-Audit | Backlink + Technik-Kombination | 5.000 Seiten/Monat | 129 $/Monat (Ahrefs) | Cloud |

Was ist ein Webcrawler?

Ein Webcrawler (auch Spider oder Bot genannt) ist ein Internetbot, der systematisch das Web durchsucht, um Seiten zu indexieren und zu katalogisieren.

Das berühmteste Beispiel? Googlebot.

Googlebot beginnt mit einer Liste bekannter URLs aus früheren Crawls und Sitemaps. Er besucht jede Seite, liest den Inhalt und folgt jedem Link, den er findet. Diese neuen Links werden seiner Warteschlange für zukünftige Besuche hinzugefügt.

Dieser Prozess wiederholt sich endlos und erstellt Googles riesigen Index von Webseiten.

Sie können eine kleinere Version auf Ihrer eigenen Website ausführen. Anstatt das gesamte Internet zu indexieren, kartiert Ihr Crawler die vollständige Struktur und den Inhalt Ihrer Website mit maschineller Genauigkeit.

Wenn Sie einen Crawler auf Ihrer eigenen Website ausführen, erhalten Sie die gleiche maschinelle Sichtbarkeit wie Google. Er liefert Ihnen eine vollständige Karte jeder URL, jedes Statuscodes, jedes Titel-Tags und jeder internen Linkstruktur auf Ihrer Domain.

Warum einen Webcrawler verwenden?

Für WordPress-Benutzer sind Webcrawler auf drei spezifische Arten nützlich:

- Technische SEO-Audits: Finden Sie defekte Links, Weiterleitungsketten, doppelte Titel, fehlende Meta-Beschreibungen und dünne Inhalte, bevor sie Ihre Rankings beeinträchtigen

- Content-Audits: Decken Sie vergessene Seiten auf: alte Landingpages, automatisch generierte Tag-Archive oder doppelte Inhalte, die sich im Laufe der Zeit ansammeln

- Website-Migrationen: Überprüfen Sie, ob jede Seite korrekt übertragen wurde, wenn Sie zu einem neuen Host, einer neuen Domain oder einem neuen Server wechseln

Der Hauptgrund für die Verwendung eines Webcrawlers sind technische SEO-Audits.

Crawler sind hervorragend darin, defekte Links, fehlerhafte Weiterleitungen, die Benutzer im Kreis schicken, fehlende oder doppelte Seitentitel, leere Meta-Beschreibungen und dünne Inhaltsseiten zu identifizieren, die Ihre Rankings beeinträchtigen könnten.

Content-Auditing ist ein weiterer wichtiger Anwendungsfall.

Crawler decken häufig vergessene Seiten auf, die Ihre SEO beeinträchtigen können, wie z. B. automatisch generierte Tag-Archive, alte Landingpages oder doppelte Inhalte, die sich im Laufe der Zeit angesammelt haben. Diese Seiten bleiben bei manuellen Audits oft unbemerkt, tauchen aber bei einem umfassenden Crawl sofort auf.

Aber hier werden Crawler absolut entscheidend: Website-Migrationen.

Wenn Sie eine WordPress-Website zu einer neuen Domain oder einem neuen Server verschieben, erstellt ein Crawler eine vollständige Karte Ihrer alten Website. Sie können diese dann mit Ihrer neuen Website vergleichen, um zu überprüfen, ob jede Seite, jede Weiterleitung und jede wichtige Datei erfolgreich übertragen wurde.

Ohne diesen Verifizierungsschritt hoffen Sie im Grunde, dass nichts verloren gegangen ist.

Wie wir Webcrawler für WordPress bewertet haben

Wir haben jeden Crawler anhand von fünf Kriterien bewertet, die für WordPress-Workflows wichtig sind:

| Kriterien | Worauf wir geachtet haben |

| Einfachheit der Einrichtung | Wie schnell kann ein Nicht-Entwickler einen Crawl starten? |

| Crawl-Tiefe | Verarbeitet es JavaScript-Rendering, Paginierung und große Websites? |

| Qualität der Berichterstattung | Werden Fehler nach Schweregrad priorisiert? Können Sie filtern und exportieren? |

| WordPress-Eignung | Gibt es einen besonderen Nutzen für WP-Website-Besitzer und Agenturen? |

| Preis-Leistungs-Verhältnis | Was sind die tatsächlichen Kosten für den Anwendungsfall, für den es am besten geeignet ist? |

Wir haben jedes Tool auf WordPress-Websites von kleinen Blogs bis hin zu großen Multisite-Netzwerken getestet. Die Preise sind Stand April 2026 verifiziert.

Unsere Empfehlungen für Web-Crawler für WordPress

Der richtige Crawler hängt von Ihrem technischen Komfortniveau und Ihren Zielen ab.

Einige sind für SEO-Profis konzipiert. Andere richten sich an Geschäftsinhaber, die einfach nur zeigen, klicken und Ergebnisse erzielen möchten.

Hier ist meine Aufschlüsselung der besten Optionen:

- Screaming Frog SEO Spider: Desktop-Anwendung, die der Goldstandard für technische SEO-Profis ist, kostenlos bis zu 500 URLs

- Webscraper.io: Chrome-Erweiterung für schnelle Datenextraktionsaufgaben ohne Softwareinstallation

- Semrush Site Audit: Umfassender Crawler innerhalb der gesamten Semrush SEO-Plattform

- Ahrefs Site Audit: Schneller Crawler mit exzellenter Visualisierung, kostenlos bis zu 5.000 Seiten pro Monat

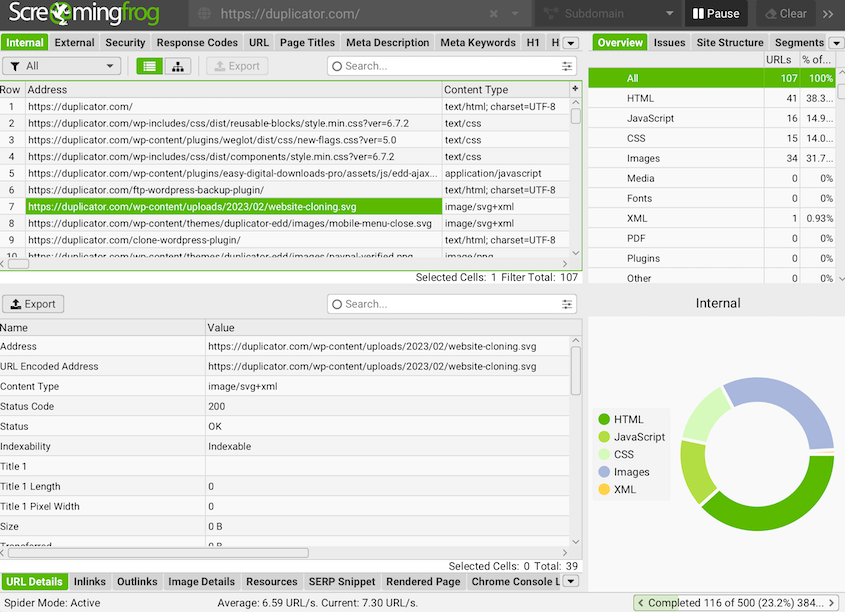

Screaming Frog SEO Spider

Screaming Frog crawlt Ihre Website, um defekte Links zu finden, Weiterleitungen zu prüfen, Seitentitel und Meta-Beschreibungen zu analysieren und spezifische Daten mithilfe von CSS-Pfad- oder XPath-Selektoren zu extrahieren. Es kann JavaScript-Rendering verarbeiten, externen Links folgen und alles zur weiteren Analyse in CSV exportieren.

Diese Desktop-Anwendung (verfügbar für Windows, macOS und Ubuntu) ist seit Jahren der Goldstandard für technische SEO-Experten.

Die kostenlose Version crawlt bis zu 500 URLs, was für die meisten kleinen bis mittelgroßen WordPress-Sites ausreicht. Für größere Websites entfernt die kostenpflichtige Lizenz diese Grenze und fügt Funktionen wie benutzerdefinierte Extraktion, Google Analytics-Integration und geplante Crawls hinzu.

Die Benutzeroberfläche kann anfangs überwältigend wirken. Ich finde jedoch, dass die Tiefe der bereitgestellten Daten unübertroffen ist.

Webscraper.io

Webscraper.io ist eine Chrome-Erweiterung, die sich auf schnelle Datenextraktionsaufgaben konzentriert.

Der Komfortfaktor ist hier riesig – keine Software zu installieren, keine komplizierte Einrichtung. Sie erstellen eine „Sitemap“ (ihr Begriff für einen Scraping-Plan) direkt in Ihrem Browser und legen fest, welche Elemente angeklickt und welche Daten extrahiert werden sollen.

Webscraper.io ist perfekt für kleinere Aufgaben wie das Sammeln einer Liste von Blog-Post-Titeln von der Website eines Mitbewerbers oder das Sammeln von Produktinformationen von einigen Seiten. Der visuelle Selektor erleichtert die gezielte Auswahl genau dessen, was Sie benötigen.

Die kostenlose Version erledigt grundlegende Scraping-Aufgaben. Kostenpflichtige Pläne bieten Cloud-basiertes Crawling, geplante Ausführungen und API-Zugriff für die Integration der Daten in andere Tools.

Semrush Website-Audit

Semrush ist eine der beliebtesten SEO-Audit-Plattformen. Sie bietet umfassende Toolkits für Vermarkter und Unternehmen, um ihr SEO zu verbessern.

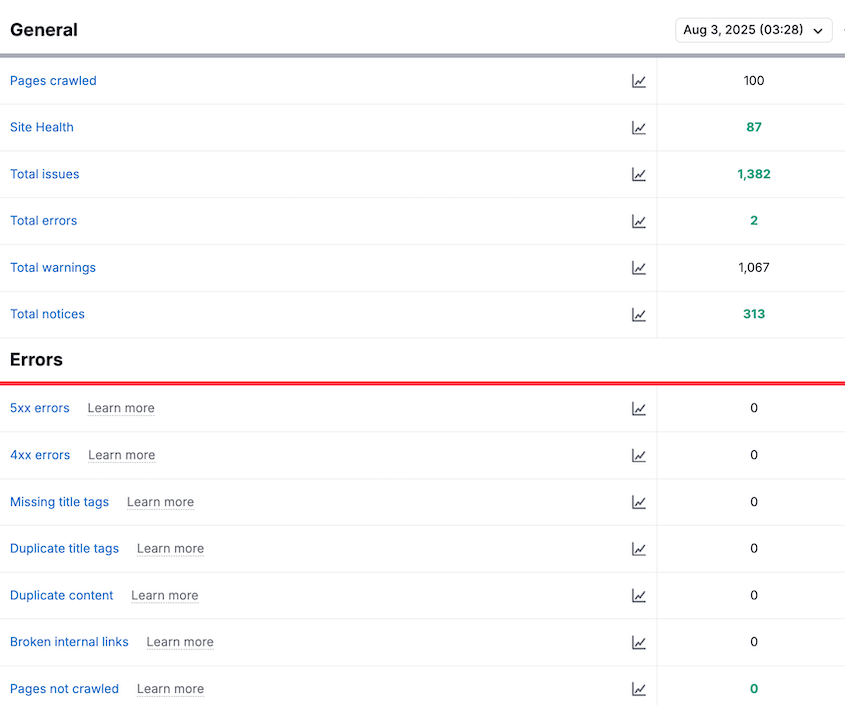

Für On-Page- und technische SEO bietet Semrush ein Site-Audit-Tool. Dieses wird durch Crawling-Technologie angetrieben.

Semrush crawlt Ihre Website und sucht nach Problemen mit der Website-Gesundheit wie doppeltem Inhalt, fehlenden Titel-Tags, defekten Bildern und anderen Fehlern. Sobald Sie von diesen Problemen wissen, können Sie sie beheben.

Wenn Sie bereits für Semrush bezahlen, ist der Site Audit Crawler enthalten. Semrush-Pläne beginnen jedoch bei 117 US-Dollar pro Monat, daher lohnt es sich wahrscheinlich nicht, nur für den Crawler ein Abonnement abzuschließen, es sei denn, Sie planen, auch die anderen SEO-Tools zu nutzen.

Ahrefs Website-Audit

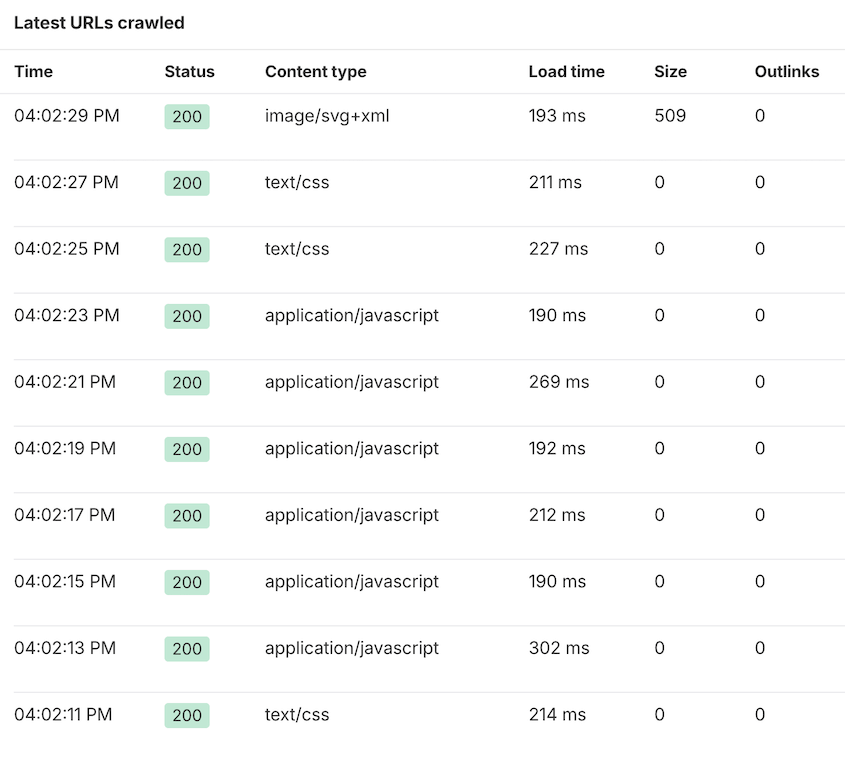

Wie Semrush führt auch Ahrefs eine umfassende Website-Analyse innerhalb seines SEO-Toolkits durch.

Der Crawler ist schnell und die Benutzeroberfläche visualisiert technische Fehler hervorragend. Sie erhalten eine Gesamt-SEO-Bewertung und eine Liste potenzieller Probleme.

Außerdem lässt es sich mit anderen Ahrefs-Tools wie dem Rank Tracker und Site Explorer integrieren. Sie können sehen, wie technische Probleme mit der Ranking-Leistung und den Backlink-Profilen korrelieren.

Sie können die Website-Analyse von Ahrefs kostenlos für bis zu 5.000 Seiten pro Monat nutzen, die gecrawlt werden.

Semrush Enterprise-Benutzer können auch die Funktion „Crawler Profiles“ von Semrush (eingeführt 2026) nutzen, um genau zu simulieren, wie bestimmte KI-Agenten Ihre Seiten sehen und interpretieren.

So verwenden Sie einen Webcrawler für eine WordPress-Migration

Hier beweisen Crawler ihren Wert. Eine ordnungsgemäße Migration umfasst zwei Crawls: einen, bevor Sie die Website verschieben, und einen danach.

Schritt 1: Der Benchmark-Crawl vor der Migration

Erstellen Sie als ersten Schritt vor der Migration Ihrer Website eine vollständige Bestandsaufnahme Ihrer aktuellen Website, indem Sie sie crawlen.

Starten Sie Ihren ausgewählten Crawler und führen Sie ihn auf Ihrer Quell-Website aus. Konfigurieren Sie ihn so, dass er die URL, den HTTP-Statuscode, den Seitentitel, die Meta-Beschreibung, die H1-Tags und die Wortanzahl für jede gefundene Seite erfasst.

Exportieren Sie alle diese Daten in eine Tabellenkalkulation. Dies wird Ihr endgültiger Nachweis dafür, wie Ihre Website vor der Migration aussah.

Schritt 2: Führen Sie Ihre Migration durch

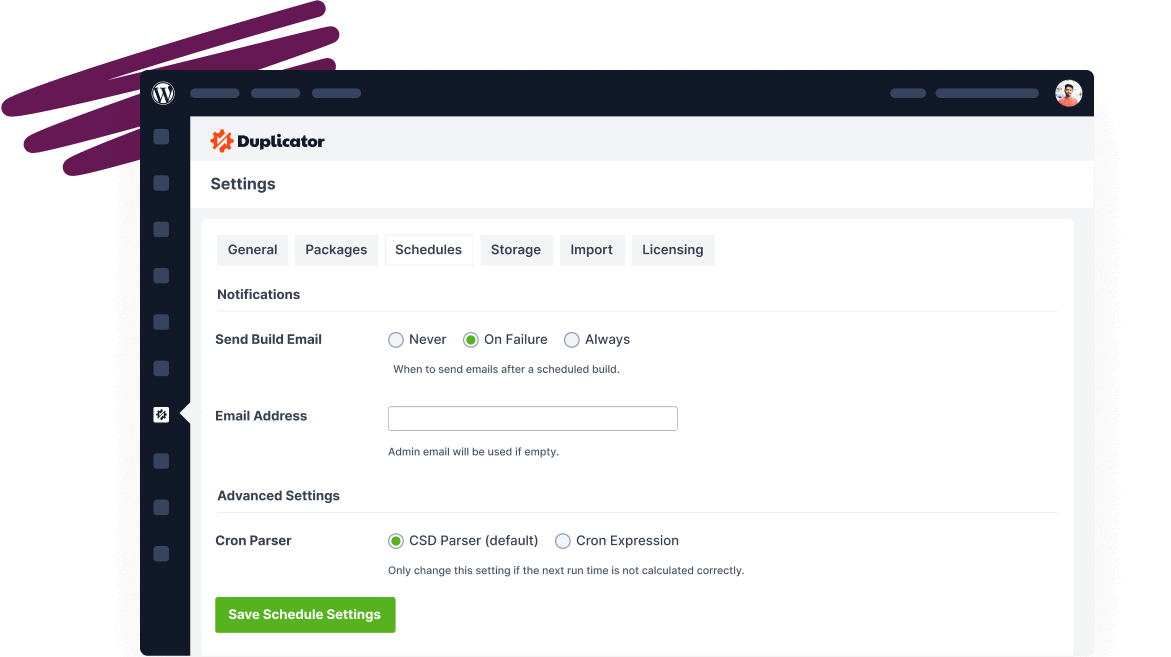

Hier kommt Duplicator ins Spiel. Während Ihr Crawler den Zustand vor der Migration dokumentiert, übernimmt Duplicator die eigentliche Verschiebung.

Duplicator verpackt Ihre gesamte WordPress-Website in eine einzige Sicherungsdatei, verschiebt sie zum neuen Host oder zur neuen Domain und kümmert sich automatisch um den Datenbank-Such- und Ersetzvorgang.

Sie können hier auch einen vollständigen Sicherungs-Snapshot erstellen, damit Sie einen Wiederherstellungspunkt haben, falls die Validierung Probleme aufdeckt.

Schritt 3: Der Validierungs-Crawl nach der Migration

Nachdem Sie Ihre Website an ihren neuen Standort verschoben haben, führen Sie die gleiche Crawl-Konfiguration auf Ihrer Ziel-Website aus.

Jetzt kommt die Detektivarbeit: Vergleichen Sie die beiden Tabellenkalkulationen. Verwenden Sie die VLOOKUP-Funktion von Excel (oder ähnliche Tools in Google Sheets), um die Daten abzugleichen.

Suchen Sie nach Seiten, die auf der alten Website den Statuscode 200 zurückgaben, auf der neuen Website aber 404er auslösen. Überprüfen Sie, ob Ihre Weiterleitungen ordnungsgemäß funktionieren – eine 301-Weiterleitung auf der alten Website sollte auf der neuen Website immer noch eine 301-Weiterleitung sein. Verifizieren Sie, dass Seitentitel und Meta-Beschreibungen intakt übernommen wurden.

Dieser Vergleichsprozess deckt Migrationsprobleme auf, die sonst monatelang unbemerkt bleiben könnten.

Häufig gestellte Fragen (FAQs)

Ist Web-Crawling legal?

Im Allgemeinen ja – das Crawlen öffentlich zugänglicher Webseiten ist legal, wenn Sie robots.txt respektieren und in angemessenem Tempo crawlen. Einige Websites verbieten das Crawling jedoch in ihren Nutzungsbedingungen. Im Zweifelsfall crawlen Sie Ihre eigenen Websites oder holen Sie sich eine ausdrückliche Erlaubnis ein.

Was ist der Unterschied zwischen einem Webcrawler, Scraper und Spider?

Ein Crawler (oder Spider) entdeckt und besucht Webinhalte, indem er Links folgt, während ein Scraper spezifische Daten von diesen Seiten extrahiert. Die meisten modernen Tools erledigen beide Funktionen. Das Verständnis der Unterschiede hilft bei der Bewertung verschiedener Tools für spezifische Aufgaben.

Welche Arten von Webcrawlern gibt es?

Webcrawler fallen in vier Hauptkategorien: technische SEO-Crawler (wie Screaming Frog), Datenextraktionstools (wie Octoparse), integrierte Suite-Crawler (eingebaut in SEO-Plattformen) und Entwickler-Frameworks (wie Scrapy). Jede dient unterschiedlichen Bedürfnissen und Erfahrungsstufen.

Was ist der beste kostenlose Webcrawler?

Für technische SEO-Arbeiten kann die kostenlose Version von Screaming Frog bis zu 500 URLs verarbeiten. Für schnelle Datenextraktion funktioniert die Webscraper.io Browser-Erweiterung gut ohne Softwareinstallation.

Verlangsamt oder schadet ein Crawler meiner Website?

Ein aggressiver Crawler kann Ihre Website verlangsamen wie ein Traffic-Anstieg, insbesondere auf Shared Hosting. Gute Crawling-Tools ermöglichen es Ihnen, die Crawling-Geschwindigkeit mit Verzögerungen zwischen Anfragen und Verbindungsbeschränkungen zu steuern. Verwenden Sie diese Einstellungen immer auf Produktionsseiten.

Wie kontrolliere ich, welche Webcrawler auf meine Website zugreifen können?

Die robots.txt-Datei teilt Crawlern mit, auf welche Teile Ihrer Website sie zugreifen können. Platzieren Sie sie unter yoursite.com/robots.txt, um bestimmte Crawler zu blockieren oder den Verzeichniszugriff einzuschränken. Beachten Sie, dass gut erzogene Crawler sie respektieren, aber bösartige Bots sie ignorieren können.

Kann AutoGPT Web Scraping durchführen?

AutoGPT kann Code für Web-Scraper mit Bibliotheken wie Scrapy schreiben, aber es führt das Crawling nicht selbst durch. Betrachten Sie es als einen Coding-Assistenten, der beim Erstellen von Scraping-Tools hilft. Sie müssen den generierten Code immer noch ausführen, um tatsächlich Websites zu crawlen.

Ihr Aktionsplan: Den richtigen Webcrawler auswählen

So wählen Sie den richtigen Crawler für Ihre Situation aus:

- Kostenlos und schnell: Ahrefs Webmaster Tools (5.000 Seiten, keine Kosten)

- Tiefgehende technische Prüfung: Screaming Frog (kostenlos bis 500 URLs, 279 $/Jahr für mehr)

- Bereits auf Semrush oder Ahrefs: Verwenden Sie Site Audit; es ist bereits enthalten

- Benötigen Sie nur spezifische Daten zu scrapen: Webscraper.io Chrome-Erweiterung

Sie können die gründlichste Crawler-Prüfung der Welt durchführen, aber wenn Ihr Migrations-Tool Dateien fallen lässt, Datenbanken beschädigt oder Ihre Website-Struktur beschädigt, wird all diese Vorbereitung sinnlos.

Deshalb empfehle ich, Ihren Crawler mit Duplicator Pro zu koppeln. Während Ihr Crawler die Vorher-Nachher-Verifizierung übernimmt, erledigt Duplicator Pro die eigentliche Schwerstarbeit beim Verschieben Ihrer WordPress-Website.

Sind Sie bereit, Ihren Migrations-Workflow zu verbessern? Probieren Sie Duplicator Pro noch heute aus und sehen Sie, warum Tausende von WordPress-Profis ihm ihre Website-Umzüge anvertrauen.

Während Sie hier sind, denke ich, dass Ihnen diese handverlesenen WordPress-Ressourcen gefallen werden: