Guida comparativa ai Web Crawler: Strumenti SEO tecnici che funzionano per WordPress nel 2026

John Turner

John Turner

John Turner

John Turner

Ti trovi di fronte a un sito WordPress con oltre 500 pagine e il tuo cliente desidera un audit completo dei link non funzionanti.

Potresti sfogliare manualmente ogni singola pagina, oppure potresti lasciare che un web crawler faccia il lavoro pesante in circa 20 minuti.

I web crawler sono bot automatizzati che navigano sistematicamente i siti web, seguendo ogni link che trovano e catalogando ciò che scoprono.

Che tu stia eseguendo l'audit del tuo sito per problemi tecnici, preparandoti per una migrazione o verificando che una migrazione sia andata a buon fine, un web crawler è uno degli strumenti più potenti a tua disposizione. Il problema è che le opzioni sembrano simili in superficie, finché non sei nel pieno di un audit e ti rendi conto di aver scelto quello sbagliato.

Utilizziamo i crawler regolarmente come parte del nostro flusso di lavoro di migrazione e backup di WordPress, il che ci offre una prospettiva specifica: quali strumenti ti aiutano effettivamente a spostare e proteggere i siti WordPress, non solo a generare report.

Ecco i punti chiave:

- Screaming Frog è l'auditor tecnico più potente. È basato su desktop, altamente configurabile, gratuito fino a 500 URL e $279/anno per un uso illimitato.

- Ahrefs Site Audit ha il miglior piano gratuito: 5.000 pagine/mese tramite Ahrefs Webmaster Tools, senza costi.

- Semrush e Ahrefs Site Audit valgono la pena solo se sei già su quelle piattaforme. A $117–$129/mese, il costo è difficile da giustificare solo per il crawling.

- Webscraper.io è uno strumento di estrazione dati, non un auditor SEO: un caso d'uso completamente diverso, ma lo strumento migliore per quel lavoro.

- Per le migrazioni di WordPress, esegui sempre un crawl pre- e post-migrazione. È l'unico modo affidabile per individuare pagine perse, reindirizzamenti interrotti o metadati modificati.

Indice

Web Crawler a colpo d'occhio

| Web Crawler | Ideale per | Piano Gratuito | Prezzi a Pagamento | Metodo di Crawl |

| Screaming Frog | Audit tecnici approfonditi | 500 URL | $279/anno | App desktop |

| Webscraper.io | Estrazione rapida di dati | Estensione del browser | 100 €/mese (cloud) | Browser / Cloud |

| Audit del sito Semrush | Utenti della piattaforma SEO all-in-one | Limitato (Semrush gratuito) | 117 €/mese (Semrush) | Cloud |

| Audit del sito Ahrefs | Combo backlink + tecnico | 5.000 pagine/mese | 129 €/mese (Ahrefs) | Cloud |

Cos'è un Web Crawler?

Un web crawler (chiamato anche spider o bot) è un bot di Internet che naviga sistematicamente sul web per indicizzare e catalogare le pagine.

L'esempio più famoso? Googlebot.

Googlebot parte da un elenco di URL noti da precedenti scansioni e sitemap. Visita ogni pagina, legge il contenuto e segue ogni link che trova. I nuovi link vengono aggiunti alla sua coda per visite future.

Questo processo si ripete all'infinito, costruendo l'enorme indice di pagine web di Google.

Puoi eseguire una versione su scala ridotta sul tuo sito web. Invece di indicizzare l'intero Internet, il tuo crawler mappa la struttura e il contenuto completo del tuo sito con precisione a livello di macchina.

Quando esegui un crawler sul tuo sito, ottieni la stessa visibilità a livello di macchina che ha Google. Ti fornirà una mappa completa di ogni URL, codice di stato, tag title e struttura di link interni sul tuo dominio.

Perché usare un Web Crawler?

Per gli utenti WordPress, i web crawler sono utili in tre modi specifici:

- Audit SEO tecnici: trova link interrotti, catene di reindirizzamento, titoli duplicati, meta description mancanti e contenuti scarsi prima che danneggino il tuo posizionamento

- Audit dei contenuti: individua pagine dimenticate: vecchie landing page, archivi di tag generati automaticamente o contenuti duplicati che si accumulano nel tempo

- Migrazioni del sito: verifica che ogni pagina sia stata trasferita correttamente durante lo spostamento verso un nuovo host, dominio o server

Il motivo principale per utilizzare un web crawler è per gli audit SEO tecnici.

I crawler eccellono nell'identificare link interrotti, reindirizzamenti errati che mandano gli utenti in circolo, titoli di pagina mancanti o duplicati, meta description vuote e pagine con contenuti scarsi che potrebbero danneggiare il tuo posizionamento.

L'audit dei contenuti è un altro caso d'uso importante.

I crawler scoprono frequentemente pagine dimenticate che possono danneggiare la tua SEO, come archivi di tag generati automaticamente, vecchie landing page o contenuti duplicati che si sono accumulati nel tempo. Queste pagine spesso sfuggono all'attenzione durante gli audit manuali ma compaiono immediatamente in una scansione completa.

Ma ecco dove i crawler diventano assolutamente fondamentali: migrazioni di siti web.

Quando sposti un sito WordPress su un nuovo dominio o server, un crawler crea una mappa completa del tuo vecchio sito. Puoi quindi confrontarla con il tuo nuovo sito per verificare che ogni pagina, ogni reindirizzamento e ogni file importante abbia completato il trasferimento con successo.

Senza questo passaggio di verifica, stai essenzialmente incrociando le dita e sperando che nulla vada perso nella traduzione.

Come abbiamo valutato i Web Crawler per WordPress

Abbiamo valutato ogni crawler in base a cinque criteri importanti per i flussi di lavoro di WordPress:

| Criteri | Cosa abbiamo cercato |

| Facilità di configurazione | Quanto velocemente un non sviluppatore può avviare un crawl? |

| Profondità del crawl | Gestisce il rendering JavaScript, la paginazione e i siti di grandi dimensioni? |

| Qualità dei report | Gli errori sono prioritizzati per gravità? È possibile filtrare ed esportare? |

| Idoneità per WordPress | C'è un valore specifico per i proprietari di siti WP e le agenzie? |

| Valore del prezzo | Qual è il costo reale per il caso d'uso per cui è più adatto? |

Abbiamo testato ogni strumento su siti WordPress che vanno da piccoli blog a grandi reti multisito. I prezzi sono verificati ad aprile 2026.

Le nostre raccomandazioni sul crawler web per WordPress

Il crawler giusto dipende dal tuo livello di comfort tecnico e da ciò che stai cercando di realizzare.

Alcuni sono costruiti per professionisti SEO. Altri si rivolgono a imprenditori che vogliono solo puntare, cliccare e ottenere risultati.

Ecco la mia analisi delle migliori opzioni:

- Screaming Frog SEO Spider: App desktop che è lo standard di riferimento per i professionisti SEO tecnici, gratuita fino a 500 URL

- Webscraper.io: Estensione Chrome per rapide attività di estrazione dati senza installazione di software

- Semrush Site Audit: Crawler completo all'interno della piattaforma SEO completa Semrush

- Ahrefs Site Audit: Crawler veloce con eccellente visualizzazione, gratuito fino a 5.000 pagine mensili

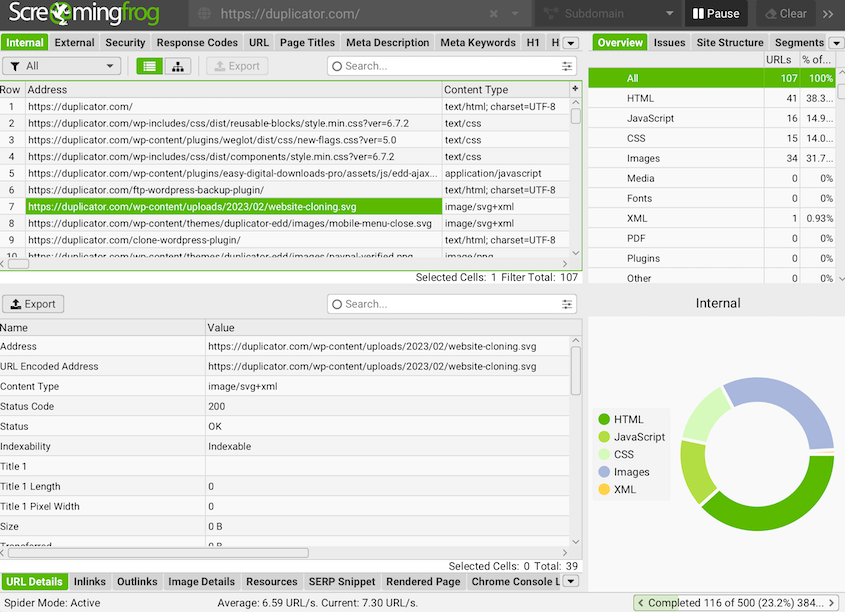

Screaming Frog SEO Spider

Screaming Frog esegue la scansione del tuo sito per trovare link interrotti, controllare i reindirizzamenti, analizzare titoli di pagina e meta description ed estrarre dati specifici utilizzando selettori CSS Path o XPath. Può gestire il rendering JavaScript, seguire link esterni ed esportare tutto in CSV per ulteriori analisi.

Questa applicazione desktop (disponibile per Windows, macOS e Ubuntu) è lo standard di riferimento per i professionisti SEO tecnici da anni.

La versione gratuita esegue la scansione fino a 500 URL, il che copre la maggior parte dei siti WordPress di piccole e medie dimensioni. Per siti più grandi, la licenza a pagamento rimuove questo limite e aggiunge funzionalità come estrazione personalizzata, integrazione con Google Analytics e crawl pianificati.

L'interfaccia può sembrare opprimente all'inizio. Tuttavia, trovo che la profondità dei dati che fornisce sia impareggiabile.

Webscraper.io

Webscraper.io è un'estensione di Chrome che si concentra su rapide attività di estrazione dati.

Il fattore comodità è enorme qui: nessun software da installare, nessuna configurazione complessa. Crei una "sitemap" (il loro termine per un piano di scraping) direttamente nel tuo browser, indicando quali elementi cliccare e quali dati estrarre.

Webscraper.io è perfetto per lavori più piccoli come raccogliere un elenco di titoli di post del blog dal sito di un concorrente o raccogliere informazioni sui prodotti da alcune pagine. Il selettore visivo rende facile individuare esattamente ciò di cui hai bisogno.

La versione gratuita gestisce attività di scraping di base. I piani a pagamento aggiungono crawling basato su cloud, esecuzioni pianificate e accesso API per integrare i dati in altri strumenti.

Audit del sito Semrush

Semrush è una delle piattaforme di audit SEO più popolari. Fornisce kit di strumenti completi per marketer e aziende per far crescere la loro SEO.

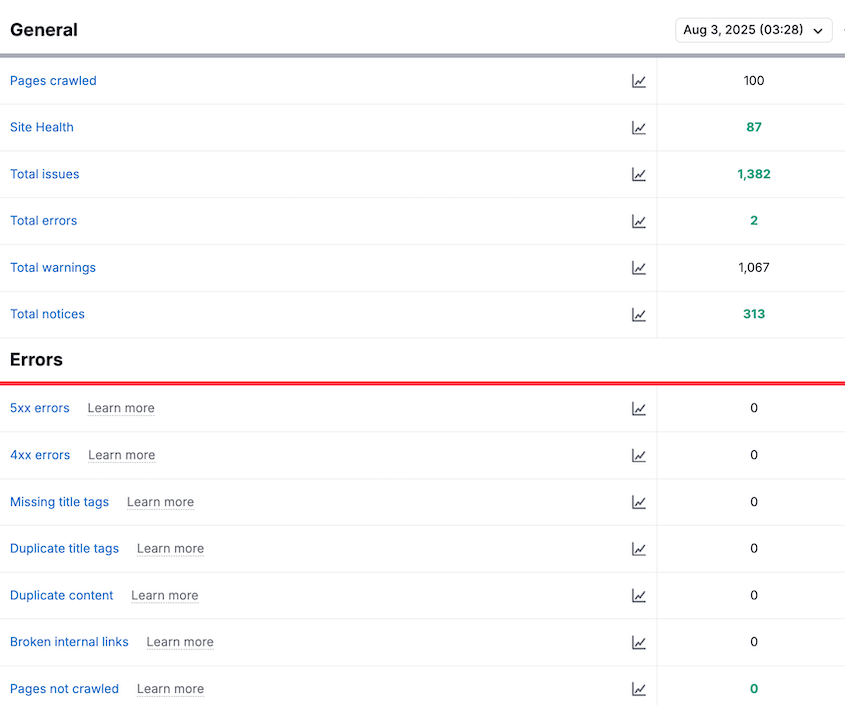

Per la SEO on-page e tecnica, Semrush fornisce uno strumento di Site Audit. Questo è alimentato da tecnologia di crawling.

Semrush eseguirà la scansione del tuo sito web, alla ricerca di problemi di salute come contenuti duplicati, tag title mancanti, immagini interrotte e altri errori. Una volta a conoscenza di questi problemi, puoi risolverli.

Se stai già pagando per Semrush, il crawler di Site Audit è incluso. Tuttavia, i piani Semrush partono da $117/mese, quindi probabilmente non vale la pena abbonarsi solo per il crawler, a meno che tu non abbia intenzione di utilizzare anche gli altri strumenti SEO.

Audit del sito Ahrefs

Come Semrush, Ahrefs esegue un Site Audit completo all'interno del suo toolkit SEO.

Il crawler è veloce e l'interfaccia fa un ottimo lavoro nel visualizzare gli errori tecnici. Ti fornisce un punteggio SEO generale e un elenco di potenziali problemi.

Inoltre, si integra con altri strumenti Ahrefs come Rank Tracker e Site Explorer. Puoi vedere come i problemi tecnici si correlano con le prestazioni di ranking e i profili dei backlink.

Puoi utilizzare Site Audit di Ahrefs gratuitamente fino a 5.000 pagine scansionate mensilmente.

Gli utenti Semrush Enterprise possono anche utilizzare la funzione Crawler Profiles di Semrush (lanciata nel 2026) per simulare esattamente come specifici agenti AI vedono e interpretano le tue pagine.

Come utilizzare un Web Crawler per una migrazione di WordPress

È qui che i crawler dimostrano il loro valore. Una migrazione corretta comporta due scansioni: una prima di spostare il sito e una dopo.

Passaggio 1: Il crawl di riferimento pre-migrazione

Come primo passo prima di migrare il tuo sito web, crea un inventario completo del tuo sito attuale eseguendo una scansione.

Avvia il crawler scelto ed eseguilo sul tuo sito di origine. Configuralo per acquisire l'URL, il codice di stato HTTP, il titolo della pagina, la meta description, i tag H1 e il conteggio delle parole per ogni pagina trovata.

Esporta tutti questi dati in un foglio di calcolo. Questo diventerà il tuo record definitivo di come appariva il tuo sito prima della migrazione.

Passaggio 2: Esegui la tua migrazione

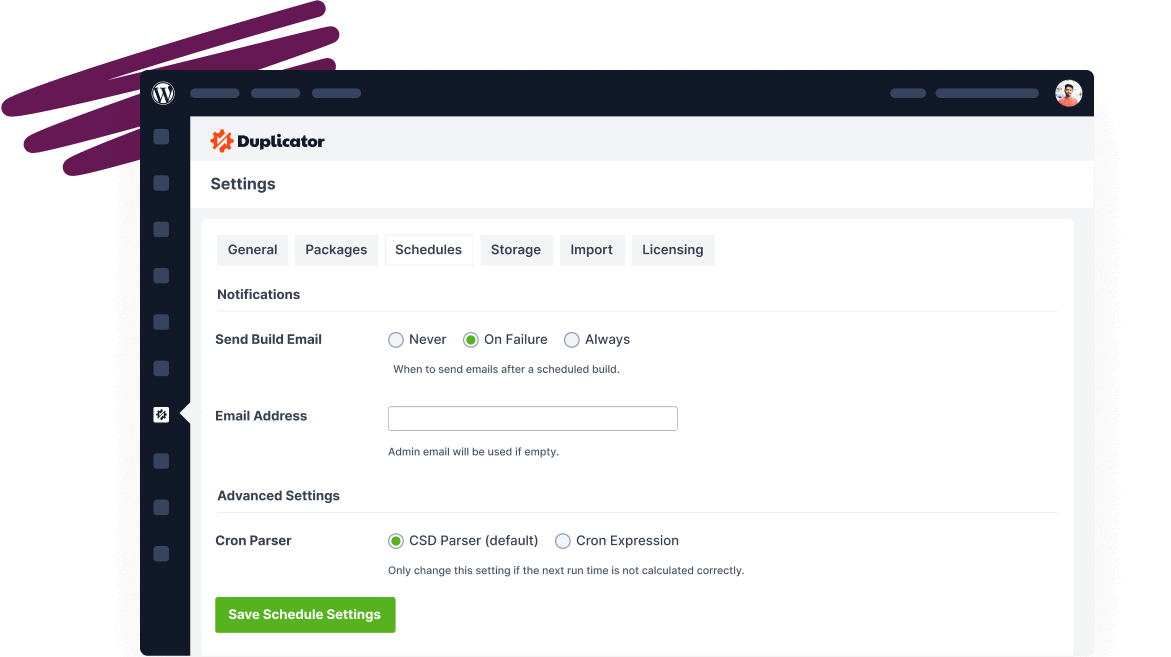

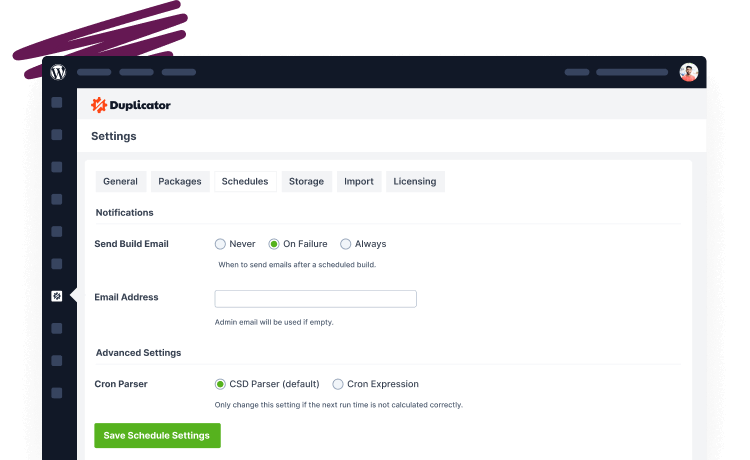

È qui che entra in gioco Duplicator. Mentre il tuo crawler documenta lo stato precedente, Duplicator gestisce lo spostamento effettivo.

Duplicator impacchetterà l'intero sito WordPress in un unico file di backup, lo sposterà sul nuovo host o dominio e gestirà automaticamente la ricerca e sostituzione del database.

Puoi anche creare uno snapshot di backup completo qui in modo da avere un punto di ripristino se la validazione rivela problemi.

Passaggio 3: Il crawl di validazione post-migrazione

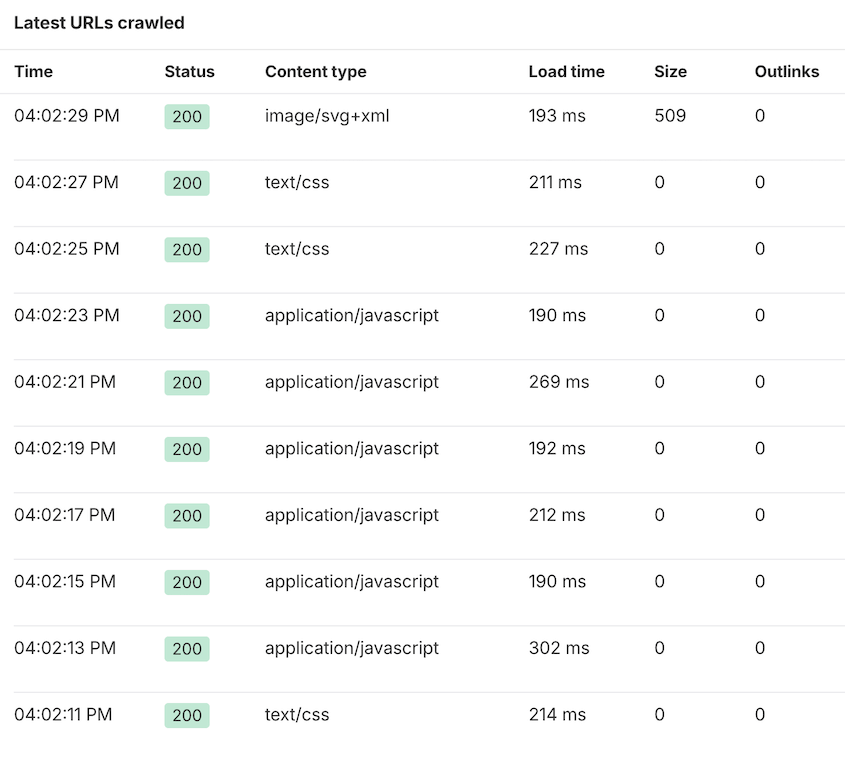

Dopo aver spostato il tuo sito nella sua nuova sede, esegui la stessa configurazione di scansione sul sito di destinazione.

Ora arriva il lavoro da detective: confronta i due fogli di calcolo. Utilizza la funzione CERCA.VERT di Excel (o strumenti simili in Google Sheets) per incrociare i dati.

Cerca le pagine che hanno restituito codici di stato 200 sul vecchio sito ma che ora generano 404. Verifica che i tuoi reindirizzamenti funzionino correttamente: un reindirizzamento 301 sul vecchio sito dovrebbe essere ancora un reindirizzamento 301 sul nuovo sito. Verifica che i titoli delle pagine e le meta description siano stati trasferiti intatti.

Questo processo di confronto individua i problemi di migrazione che altrimenti potrebbero passare inosservati per mesi.

Domande frequenti (FAQ)

Il web crawling è legale?

Generalmente sì, eseguire la scansione di pagine web accessibili pubblicamente è legale se si rispetta robots.txt e si esegue la scansione a un ritmo ragionevole. Tuttavia, alcuni siti proibiscono il crawling nei loro termini di servizio. In caso di dubbio, esegui la scansione dei tuoi siti o ottieni un'autorizzazione esplicita.

Qual è la differenza tra un web crawler, uno scraper e uno spider?

Un crawler (o spider) scopre e visita pagine web seguendo i link, mentre uno scraper estrae dati specifici da quelle pagine. La maggior parte degli strumenti moderni svolge entrambe le funzioni. Comprendere la distinzione aiuta quando si valutano diversi strumenti per attività specifiche.

Quali sono i tipi di web crawler?

I web crawler rientrano in quattro categorie principali: crawler SEO tecnici (come Screaming Frog), strumenti di estrazione dati (come Octoparse), crawler di suite integrate (integrati nelle piattaforme SEO) e framework per sviluppatori (come Scrapy). Ognuno serve esigenze e livelli di competenza diversi.

Qual è il miglior web crawler gratuito?

Per il lavoro di SEO tecnico, il livello gratuito di Screaming Frog gestisce fino a 500 URL. Per una rapida estrazione dati, l'estensione del browser Webscraper.io funziona bene senza installazione di software.

Un crawler rallenterà o danneggerà il mio sito web?

Un crawler aggressivo può rallentare il tuo sito come un picco di traffico, specialmente su hosting condiviso. I buoni strumenti di crawling ti consentono di controllare la velocità di scansione con ritardi tra le richieste e limiti di connessione. Utilizza sempre queste impostazioni sui siti di produzione.

Come controllo quali web crawler possono accedere al mio sito?

Il file robots.txt indica ai crawler quali parti del tuo sito possono accedere. Posizionalo su tuosito.com/robots.txt per bloccare crawler specifici o limitare l'accesso alle directory. Tieni presente che i crawler ben educati lo rispettano, ma i bot malevoli possono ignorarlo.

AutoGPT può fare web scraping?

AutoGPT può scrivere codice per web scraper utilizzando librerie come Scrapy, ma non esegue il crawling stesso. Pensalo come un assistente di codifica che aiuta a costruire strumenti di scraping. Devi ancora eseguire il codice generato per eseguire effettivamente la scansione dei siti web.

Il tuo piano d'azione: scegliere il web crawler giusto

Ecco come scegliere il crawler giusto per la tua situazione:

- Gratuito e veloce: Ahrefs Webmaster Tools (5.000 pagine, nessun costo)

- Audit tecnico approfondito: Screaming Frog (gratuito fino a 500 URL, $279/anno per di più)

- Già su Semrush o Ahrefs: usa Site Audit; è già incluso

- Hai solo bisogno di estrarre dati specifici: estensione Chrome Webscraper.io

Puoi eseguire l'audit crawler più approfondito del mondo, ma se il tuo strumento di migrazione perde file, danneggia database o corrompe la struttura del tuo sito, tutta quella preparazione diventa inutile.

Ecco perché consiglio di abbinare il tuo crawler a Duplicator Pro. Mentre il tuo crawler gestisce la verifica prima e dopo, Duplicator Pro gestisce il vero lavoro pesante di spostamento del tuo sito WordPress.

Pronto a migliorare il tuo flusso di lavoro di migrazione? Prova Duplicator Pro oggi stesso e scopri perché migliaia di professionisti WordPress si fidano di esso per i trasferimenti dei loro siti.

Mentre sei qui, penso che ti piaceranno queste risorse WordPress selezionate con cura: